深層学習において、データのベクトル化は計算速度とモデルの学習効率を向上させる重要なテクニックです。この記事では、「抽象的なトラックのベクトル」をベクトル化の適用例として取り上げ、ミニバッチ勾配降下法、バイアス-バリアンス問題の処理、ドロップアウトなどの最適化技術について解説します。

深層学習におけるベクトル化:抽象的なトラックのベクトルの例

ベクトル化 (vectorization) は、データをベクトルまたは行列の形式に変換するプロセスで、CPUまたはGPU上で並列計算を実行できます。ループを使用してデータ要素を個別に処理する代わりに、ベクトル化を使用すると、複数の要素を同時に処理できるため、計算時間が大幅に短縮されます。

「抽象的なトラックのベクトル」を、トラックの特性 (積載量、サイズ、輸送する貨物の種類など) を表すベクトルとして想像してください。これらの各特性は、ベクトルの要素になります。ベクトルを使用すると、各特性を個別に計算するのではなく、特性の集合全体に対して同時に計算を実行できます。たとえば、10台のトラックの総積載量を計算したい場合、ループを使用して各トラックの積載量を合計するのではなく、1回のベクトル加算を実行できます。

中古トラックの価格をその特性に基づいて予測する問題にベクトル化を適用すると、ループを使用するよりも計算効率が向上します。NumPyなどのライブラリはベクトル化を強力にサポートしており、深層学習アルゴリズムの実装がより効率的になります。

抽象的なトラックのベクトル

抽象的なトラックのベクトル

ミニバッチ勾配降下法:モデル学習の最適化

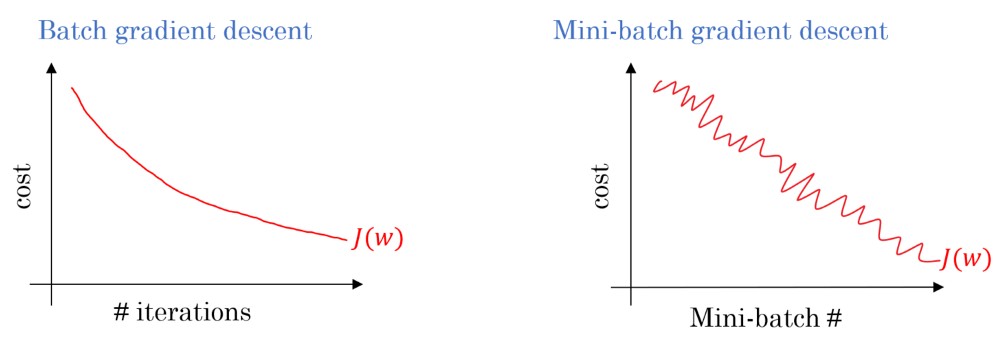

大量のデータで深層学習モデルを学習する場合、各反復で勾配を計算するためにデータ全体を使用する (バッチ勾配降下法) と、時間とリソースが非常に消費されます。ミニバッチ勾配降下法は、データを小さなバッチに分割し、各バッチで勾配を計算する効果的なソリューションです。

「抽象的なトラックのベクトル」の場合、ミニバッチ勾配降下法は、トラックのデータセットを小さなグループに分割します。各グループは、モデルの重みを更新するために使用されます。これにより、学習プロセスが高速化され、メモリ使用量が削減されます。

バイアスとバリアンスの処理:モデルのバランス

バイアスとバリアンスは、モデルのパフォーマンスに影響を与える2つの重要な要素です。High bias (未適合) は、モデルが単純すぎてデータの複雑な特性を学習できない場合に発生します。High variance (過剰適合) は、モデルが複雑すぎて学習データを記憶し、汎化能力が低下する場合に発生します。

モデルのバランスをとるには、バイアスとバリアンスの交点を見つける必要があります。正則化 (L1、L2) やドロップアウトなどの手法は、過剰適合を軽減するのに役立ちます。

ドロップアウト:過剰適合の防止

ドロップアウトは正則化のテクニックで、学習中に一部のニューロンをランダムに「オフ」にします。これにより、モデルが特定のニューロンに過度に依存するのを防ぎ、汎化能力を高めます。

活性化関数:非線形性の役割

活性化関数は、モデルに非線形性をもたらす上で重要な役割を果たします。一般的な活性化関数には、シグモイド関数、tanh関数、ReLU関数、Leaky ReLU関数などがあります。適切な活性化関数を選択することで、学習速度とモデルのパフォーマンスに影響を与える可能性があります。ReLUとそのバリエーションは、計算が簡単で、勾配消失問題を克服できるため、よく使用されます。

結論

ベクトル化、ミニバッチ勾配降下法、バイアス-バリアンスの処理、ドロップアウト、活性化関数は、深層学習モデルのパフォーマンスを最適化する上で重要なテクニックです。これらのテクニックを適切に適用することで、強力で汎化能力の高いモデルを構築できます。「抽象的なトラックのベクトル」は、データの処理とモデルの学習におけるベクトル化の威力を示す例です。輸送分野での技術の応用について詳しくは、Xe Tải Mỹ Đìnhにお問い合わせください。